GPU 비용 낭비 없이 4배 빠르게: 앤드류 카파시의 Autoresearch 활용 방법

VESSL Cloud K=4 fan-out으로 karpathy autoresearch 16 실험을 2시간에서 40분으로 단축. GPU 동일, $5.10 비용 동일, 처리량만 4배. 멘탈 모델과 핵심 패턴 정리.

VESSL AI 팀의 최신 업데이트, 엔지니어링 인사이트, 제품 소식을 전합니다.

VESSL Cloud K=4 fan-out으로 karpathy autoresearch 16 실험을 2시간에서 40분으로 단축. GPU 동일, $5.10 비용 동일, 처리량만 4배. 멘탈 모델과 핵심 패턴 정리.

VESSL Cloud A100에서 Gemma 4 E4B를 15분 만에 파인튜닝하는 전체 과정. QLoRA + Unsloth로 VRAM 10GB, 비용 $0.38.

터미널만으로 VESSL Cloud를 전부 다룰 수 있는 공식 CLI가 공개됐어요. MCP 서버와 Claude Skill도 함께 탑재했어요.

잠든 사이 워크스페이스가 돌며 크레딧이 빠져나가던 경험, 한 번쯤 있으시죠? 배치 잡은 제출하면 자동으로 끝나요. 실패해도 돈이 새지 않는 구조예요.

안재만 베슬AI 대표가 매일경제 인터뷰에서 네오클라우드 전략과 미국 월 3배 성장 비결을 풀어놨어요.

GPUaaS 시장이 빠르게 크면서 삼성SDS와 베슬AI가 국내 주목 기업으로 떠올랐어요.

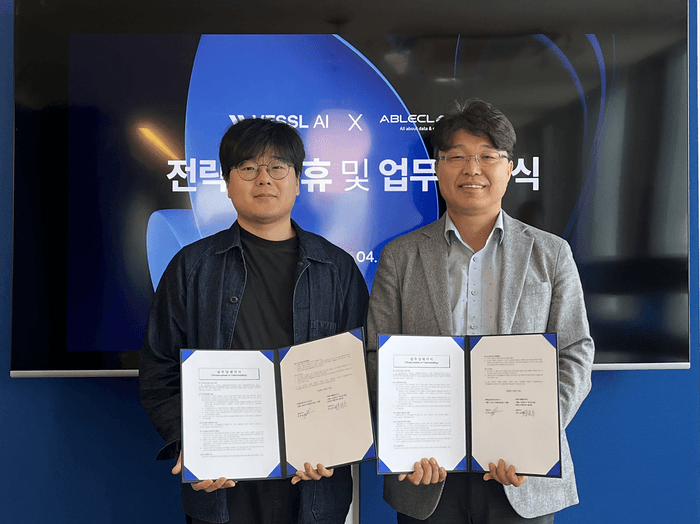

베슬AI와 에이블클라우드가 국산 클라우드에 AI GPU 플랫폼을 결합하는 MOU를 맺었어요.

VESSL Cloud 사용법을 처음부터 끝까지. 가입, GPU 선택, Workspace, vesslctl CLI, Job, 팀 협업, 비용 최적화까지 한 글에 정리했어요.

안녕하세요, VESSL AI 팀입니다. 올해도 AI EXPO KOREA 행사 시즌이 돌아왔어요! VESSL AI 팀이 5월 6일(수)~8일(금), 서울 COEX에서 열리는 AI EXPO KOREA 2026에 참가해요. 이번 전시에서는 'GPU 고민 끝내는 네오클라우드'를 주제로, GPU 클라우드 플랫폼 VESSL Cloud를 직접 만나볼 수 있어요. GPU 인프라, 어디서 어떻게 잘 구성하면 좋을지 고민이셨다면? 이번 EXPO에서 뵈어요. 부스에서 이런 걸 경험하실 수 있어요 * 설명/데모존 — A100, H100부터 최신 GB200, B300까지. 워크로드에 맞는 GPU클라우드를 VESSL Cloud에서 어떻게 쉽고 빠르게 쓸 수 있는지 현장에서 바로 확인할 수 있어요. * 미니 세미나 — 멀티모달, 피지컬 AI, LLM 추론까지. 3가지 주제로 매일 20분씩 운영해요. * 11시 - 멀티 모달 AI, 실험 속도가 모델을 결정한다 * 13시 30분

이 글은 VESSL AI 팀이 작성했으며, 비교 대상 중 하나로 VESSL Cloud를 포함하고 있어요. 모든 가격은 2026년 4월 기준 각 서비스의 공식 사이트에서 직접 확인한 온디맨드(정가) 요금이에요. GPU 클라우드란? GPU 클라우드는 NVIDIA A100, H100, B200 같은 고성능 GPU를 온디맨드로 제공하는 클라우드 서비스예요. AI 모델 학습, 파인튜닝, 추론에 필요한 GPU를 직접 구매하지 않고 시간 단위로 빌려 쓸 수 있어요. 필요한 만큼만 쓰고, 안 쓸 때는 바로 반납할 수 있어요. GPU 1장을 직접 사려면 A100 기준 약 $7,000~$15,000(약 980만~2,100만원), H100 기준 약 $25,000~$40,000(약 3,500만~5,600만원)이 들어요. 전기료랑 냉각 비용만 해도 만만치 않고, 서버 구성이나 유지보수까지 생각하면 초기 투자가 꽤 부담돼요. GPU 클라우드를 쓰면 이런 비용 없이 시간당 수천 원으로 바로 시작할

Google Colab은 대부분의 ML 엔지니어가 처음 GPU를 접하는 곳이에요. 무료로 T4를 쓸 수 있고, 설치 없이 바로 주피터 노트북이 열리니까요. 저희 VESSL AI 사용자분들도 Colab에서 시작해 GPU 클라우드로 넘어오시는 경우가 많아요. 그런데 LLM 파인튜닝이나 대규모 모델 학습을 시작하면, Colab의 한계가 분명하게 느껴지는 순간이 와요. 오늘은 그 순간이 언제인지, 그리고 GPU 클라우드로 넘어갈 때 어떤 기준으로 선택하면 되는지 정리해 볼게요. Google Colab이란? 무료 GPU 클라우드 노트북의 대명사 Google Colab(코랩)은 Google이 제공하는 클라우드 기반 주피터 노트북 서비스예요. 브라우저에서 바로 Python 코드를 실행할 수 있고, 무료로 GPU(T4)와 TPU에 접근할 수 있어요. 2026년 기준 Colab의 유료 플랜은 Colab Pro(월 $11.99), Colab Pro+(월 $49.99), Pay As You

피지컬 AI의 3-Computer 루프(시뮬레이션→학습→배포)는 각 단계마다 완전히 다른 GPU를 요구해요. 이 구조적 병목을 GPU 클라우드로 해결하는 방법을 정리했어요. 이 글은 AI타임스 주최 Physical AI Conference 2026(2026.04.09, 코엑스)에서 VESSL AI 전지환 CTO가 발표한 내용을 정리했어요. 피지컬 AI는 텍스트·이미지 같은 디지털 데이터뿐 아니라, 로봇의 물리적 동작(액션)까지 다루는 AI 분야예요. 시뮬레이션에서 합성 데이터를 만들고, GPU 클러스터로 모델을 학습하고, 현장에 배포하는 3-Computer 루프를 빠르게 반복하는 것이 핵심이에요. 피지컬 AI가 뜨거운 키워드가 되었지만, 막상 현장에 적용하려면 벽을 느끼는 팀이 많아요. 단일 동작 성공률이 90%라고 해도, 공정 내 8번 반복하면 전체 성공률은 약 43%로 떨어지거든요. 라인 3곳 중 1곳 이상이 멈출 수 있는 수준이에요. 왜 이렇게 어려울까요? 이 글에서

최종 업데이트: 2026년 4월 VESSL Cloud는 VESSL AI가 만든 GPU 클라우드(GPUaaS) 서비스로, AI 모델 학습과 추론에 필요한 GPU를 즉시 사용할 수 있어요. 핵심 요약: * GPU 라인업: A100($1.55/hr) ~ H100($2.39/hr) ~ B300($7.50/hr) * 하이퍼스케일러 대비: 20~40% 저렴 (AWS H100 $3.90 vs VESSL $2.39) * 시작 시간: 가입 후 평균 3분 (할당량 승인 불필요) * 과금: 분 단위 * 보안: SOC 2 Type II 인증 * 멀티 클라우드: AWS, GCP, Oracle 등 10개+ 통합 AWS, GCP, Oracle 등 10개 이상의 클라우드 GPU를 하나의 플랫폼에서 통합 관리하며, 할당량 승인 없이 가입 후 3분 안에 바로 GPU를 사용할 수 있어요. A100, H100, L40S, B200, GB200, B300 등 최신 GPU를 온디맨드·예약형(RI) 방

L40S, RTX Pro 6000, A100, H100, H200, B200, GB200, B300 — 어떤 GPU가 우리 워크로드에 맞을까? 스펙 비교표와 워크로드별 추천을 정리했어요.

"GPU를 써야 하는데, AWS에서 할당받으려면 몇 주를 기다려야 한다고요?" AI 프로젝트를 시작하려는데 GPU 확보부터 막히는 경험, 한 번쯤 있으실 거예요. 기존 클라우드에서 고성능 GPU를 빌리려면 대기 시간도 길고, 비용도 만만치 않죠. 이 문제를 정면으로 해결하는 새로운 클라우드 카테고리가 바로 **네오클라우드(Neocloud)**예요. 이 글에서는 네오클라우드가 무엇인지, 기존 클라우드와 뭐가 다른지, 그리고 한국에서 바로 시작할 수 있는 방법까지 정리해 드릴게요. 이 글은 VESSL AI 팀이 작성했고, VESSL Cloud 소개를 포함해요. 네오클라우드(Neocloud)란 무엇인가요? 네오클라우드(Neocloud)란, AI 모델 학습과 추론을 위한 GPU를 서비스형(GPUaaS)으로 제공하는 차세대 클라우드 사업자로, AWS·Azure·GCP 같은 범용 하이퍼스케일러와 구별되는 GPU 전용 클라우드예요. 2024년 말부터 사용되기 시작한 용어로, AI 연

이 글은 VESSL AI 팀이 작성했으며, VESSL Cloud 소개를 포함해요. 스펙 데이터는 NVIDIA 공식 데이터시트 기준이에요. (2026년 4월 기준) H100 대비 2.3배 이상 성능 | 192GB HBM3e VRAM | 문의 시 확보 가능 NVIDIA B200 GPU는 왜 주목받고 있을까요? NVIDIA B200은 Blackwell 아키텍처 기반의 데이터센터용 GPU예요. 192GB HBM3e 메모리(클라우드 환경 사용 가능 용량 약 180GB)와 FP4 기준 최대 9,000 TFLOPS 연산 성능을 갖추고 있어요. H100 대비 2배 이상 빠른 연산 능력과 2.4배 큰 VRAM이 특징이에요. 대규모 AI 학습과 추론 모두에서 현시점 가장 현실적인 차세대 GPU예요. 이 글에서는 H100 대비 B200의 가격, 스펙, 클라우드별 제공 현황, 추천 대상을 정리했어요. H100 다음, 뭘 써야 할까? H100으로 모델 학습을 돌리는데 시간이 너무